前几天,一款名为“ZAO”的AI换脸APP在朋友圈刷屏。用户上传自拍,就可以把多部经典影视剧主角的脸替换成自己的脸。但在走红的同时,人们也对AI换脸技术带来的个人信息泄露风险产生了担忧。9月4日,工信部约谈涉事公司,要求其依法依规收集使用用户个人信息。

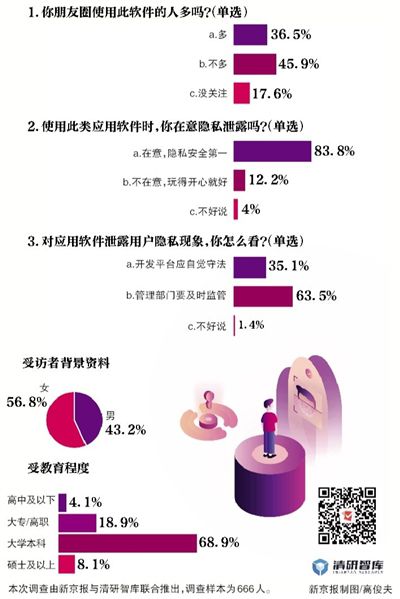

该如何看待应用软件用户隐私安全问题?本期“京报调查”(新京报与清研智库联合推出)展开调查。

■ 旁边评论

创新要以尊重用户权益为前提

“如果您把用户内容中的人脸换成您或其他人的脸,您同意或确保肖像权利人同意授予‘ZAO’及其关联公司全球范围内完全免费、不可撤销、永久、可转授权和可再许可的权利,包括但不限于人脸照片、图片、视频资料等肖像资料中所含的您或肖像权利人的肖像权,以及利用技术对您或肖像权利人的肖像进行形式改动。”

这样的用户协议实际上是要求用户将自己的肖像资料完全让渡出去,显然已涉嫌侵犯用户的个人信息隐私,况且,不同于一般的个人信息,人的面部识别信息更敏感,这就意味着,与其相关联的身份证明、金融账户等也都面临着巨大的风险。用户协议做成“霸王条款”,引起舆论反弹也是必然。

随着社会的不断发展,人们的隐私保护意识也越来越强,监管回应舆论的速度也越来越快。此次“ZAO”从火爆到被约谈下架,只有短短三四天的时间即为例证。

但要从根本上避免此类事件发生,还需要形成长效机制。除职能部门的监管外,有必要及时完善现有相关法律法规,建立严格的惩处机制,倒逼企业加强自律。

市场欢迎科技创新,但创新必须以遵守法律规范为前提。任何不尊重用户权益、试图打法律擦边球的创新,注定不会长久。毕竟,“愿意用自己隐私换便利”的人只是极少数。

□井彩霞(媒体人)